Trigonometría

La trigonometría es una rama de la matemática, cuyo significado etimológico es "la medición de los triángulos". Se deriva del vocablo griego τριγωνο <trigōno> "triángulo" + μετρον <metron> "medida".[1]

La trigonometría es la rama de las matemáticas que estudia las relaciones entre los ángulos y los lados de los triángulos. Para esto se vale de las razones trigonométricas, las cuales son utilizadas frecuentemente en cálculos técnicos.

En términos generales, la trigonometría es el estudio de las funciones seno, coseno; tangente, cotangente; secante y cosecante. Interviene directa o indirectamente en las demás ramas de la matemática y se aplica en todos aquellos ámbitos donde se requieren medidas de precisión. La trigonometría se aplica a otras ramas de la geometría, como es el caso del estudio de las esferas en la geometría del espacio.

Posee numerosas aplicaciones: las técnicas de triangulación, por ejemplo, son usadas en astronomía para medir distancias a estrellas próximas, en la medición de distancias entre puntos geográficos, y en sistemas de navegación por satélites.

El Canadarm 2, un brazo manipulador robótico gigantesco de la Estación Espacial Internacional. Este manipulador es operado controlando los ángulos de sus articulaciones. Calcular la posición final del astronauta en el extremo del brazo requiere un uso repetido de las funciones trigonómetricas de esos ángulos que se forman por los varios movimientos que se realizan.

Unidades angulares [editar]

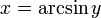

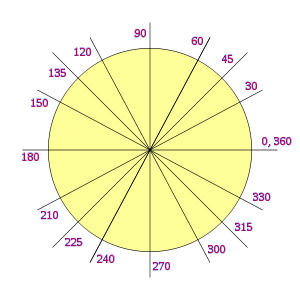

En la medida de ángulos, y por tanto en trigonometría, se emplean tres unidades, si bien la más utilizada en la vida cotidiana es el Grado sexagesimal, en matemáticas es el Radián la más utilizada, y se define como la unidad natural para medir ángulos, el Grado centesimal se desarrolló como la unidad más próxima al sistema decimal, se usa en topografía, arquitectura o en construcción.

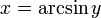

- Radián: unidad angular natural en trigonometría, será la que aquí utilicemos. En una circunferencia completa hay 2π radianes.

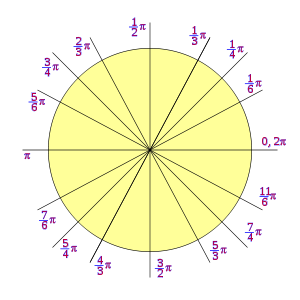

- Grado sexagesimal: unidad angular que divide una circunferencia en 360 grados.

- Grado centesimal: unidad angular que divide la circunferencia en 400 grados centesimales.

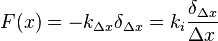

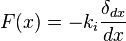

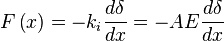

Razones trigonométricas

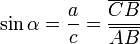

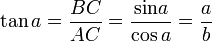

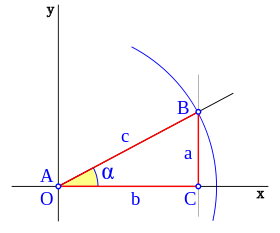

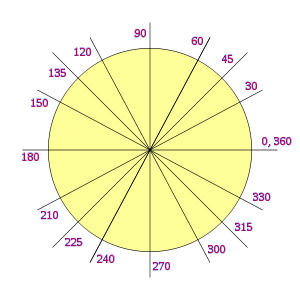

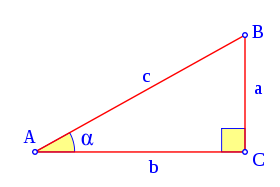

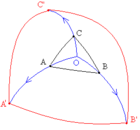

El triángulo ABC es un triángulo rectángulo en C; lo usaremos para definir las razones seno, coseno y tangente, del ángulo  , correspondiente al vértice A, situado en el centro de la circunferencia.

, correspondiente al vértice A, situado en el centro de la circunferencia.

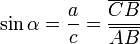

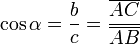

- El seno (abreviado como sen, o sin por llamarse "sinus" en latín) es la razón entre el cateto opuesto sobre la hipotenusa,

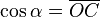

- El coseno (abreviado como cos) es la razón entre el cateto adyacente sobre la hipotenusa,

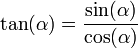

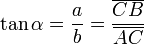

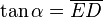

- La tangente (abreviado como tan o tg) es la razón entre el cateto opuesto sobre el cateto adyacente,

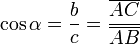

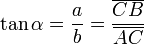

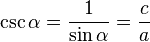

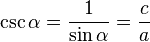

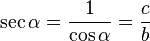

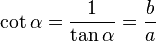

Razones trigonométricas recíprocas

Se definen la cosecante, la secante y la cotangente, como las razones recíprocas al seno, coseno y tangente, del siguiente modo:

- cosecante: (abreviado como csc o cosec) es la razón recíproca de seno, o también su inverso multiplicativo:

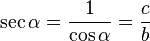

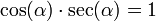

- secante: (abreviado como sec) es la razón recíproca de coseno, o también su inverso multiplicativo:

- cotangente: (abreviado como cot o cta) es la razón recíproca de la tangente, o también su inverso multiplicativo:

Normalmente se emplean las relaciones trigonométricas seno, coseno y tangente, y salvo que haya un interés especifico en hablar de ellos o las expresiones matemáticas se simplifiquen mucho, los términos cosecante, secante y cotangente no suelen utilizarse.

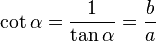

Funciones trigonométricas inversas

En trigonometría, cuando el ángulo se expresa en radianes (dado que un radián es el arco de circunferencia de longitud igual al radio), suele denominarse arco a cualquier cantidad expresada en radianes; por eso las funciones inversas se denominan con el prefijo arco, así si:

y es igual al seno de x, la función inversa:

x es el arco cuyo seno vale y, o también x es el arcoseno de y.

si:

y es igual al coseno de x, la función inversa:

x es el arco cuyo coseno vale y, que se dice: x es el arcocoseno de y.

si:

y es igual al tangente de x, la función inversa:

x es el arco cuya tangente vale y, ó x es igual al arcotangente de y.

Valor de las funciones trigonométricas

A continuación algunos valores de las funciones que es conveniente recordar:

|  |

| Circunferencia en radianes. | Circunferencia en Grado sexagesimal. |

| Radianes | Grados sexag. | seno | coseno | tangente | cosecacnte | secante | cotangente |

|---|

|  |  |  |  |  |  |  |

|  |  |  |  |  |  |  |

|  |  |  |  |  |  |  |

|  |  |  |  |  |  |  |

|  |  |  |  |  |  |  |

Para el calculo del valor de las funciones trigonométricas se confeccionaron tablas trigonométricas. La primera de estas tablas fue desarrollada por Johann Müller Regiomontano en 1467, que nos permiten, conocido un ángulo, calcular los valores de sus funciones trigonométricas. En la actualidad dado el desarrollo de la informática, en prácticamente todos los lenguajes de programación existen librerías de funciones que realizan estos cálculos, incorporadas incluso en calculadoras electrónicas de bolsillo, por lo que el empleo actual de las tablas resulta obsoleto.

Sentido de las funciones trigonométricas

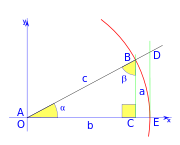

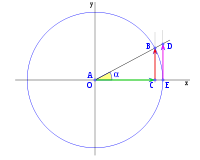

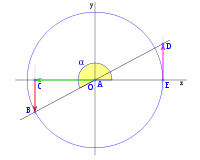

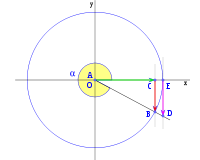

Dados los ejes de coordenadas cartesianas xy, de centro O, y una circunferencia goniométrica (circunferencia de radio la unidad) con centro en O; el punto de corte de la circunferencia con el lado positivo de las x, lo señalamos como punto E.

Notese que el punto A es el vertice del triangulo, y O es el centro de coordenada del sistema de referencia:

a todos los efectos.

La recta r, que pasa por O y forma un ángulo  sobre el eje de las x, corta a la circunferencia en el punto B, la vertical que pasa por B, corta al eje x en C, la vertical que pasa por E corta a la recta r en el punto D.

sobre el eje de las x, corta a la circunferencia en el punto B, la vertical que pasa por B, corta al eje x en C, la vertical que pasa por E corta a la recta r en el punto D.

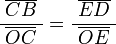

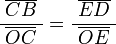

Por semejanza de triángulos:

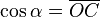

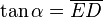

Los puntos E y B están en la circunferencia de centro O, por eso la distancia  y

y  son el radio de la circunferencia, en este caso al ser una circunferencia de radio = 1, y dadas las definiciones de las funciones trigonométricas:

son el radio de la circunferencia, en este caso al ser una circunferencia de radio = 1, y dadas las definiciones de las funciones trigonométricas:

tenemos:

La tangente es la relación del seno entre el coseno, según la definición ya expuesta.

Primer cuadrante

Partiendo de esta representación geométrica de las funciones trigonométricas, podemos ver las variaciones de las funciones a medida que aumenta el ángulo  .

.

Para  , tenemos que A, C, y D coinciden en B, por tanto:

, tenemos que A, C, y D coinciden en B, por tanto:

Si aumentamos progresivamente el valor de  , las distancias

, las distancias  y

y  aumentaran progresivamente, mientras que

aumentaran progresivamente, mientras que  disminuirá.

disminuirá.

Percatarse que  y

y  están limitados por la circunferencia y por tanto su máximo valor absoluto será 1, pero

están limitados por la circunferencia y por tanto su máximo valor absoluto será 1, pero  no está limitado, dado que D es el punto de corte de la recta r que pasa por O, y la vertical que pasa por E, en el momento en el que el ángulo

no está limitado, dado que D es el punto de corte de la recta r que pasa por O, y la vertical que pasa por E, en el momento en el que el ángulo  rad, la recta r será la vertical que pasa por O. Dos rectas verticales no se cortan, o lo que es lo mismo la distancia

rad, la recta r será la vertical que pasa por O. Dos rectas verticales no se cortan, o lo que es lo mismo la distancia  será infinita.

será infinita.

La tangente toma valor infinito cuando  rad, el seno vale 1 y el coseno 0.

rad, el seno vale 1 y el coseno 0.

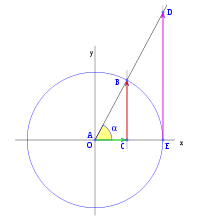

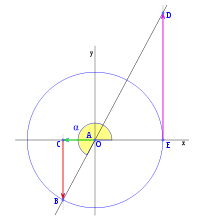

Segundo cuadrante

Cuando el ángulo  supera el ángulo recto, el valor del seno empieza a disminuir según el segmento

supera el ángulo recto, el valor del seno empieza a disminuir según el segmento  , el coseno aumenta según el segmento

, el coseno aumenta según el segmento  , pero en el sentido negativo de las x, el valor del coseno toma sentido negativo, si bien su valor absoluto aumenta cuando el ángulo sigue creciendo.

, pero en el sentido negativo de las x, el valor del coseno toma sentido negativo, si bien su valor absoluto aumenta cuando el ángulo sigue creciendo.

La tangente para un ángulo  inferior a

inferior a  rad se hace infinita en el sentido positivo de las y, para el ángulo recto la recta vertical r que pasa por O y la vertical que pasa por E no se cortan, por lo tanto la tangente no toma ningún valor real, cuando el ángulo supera los

rad se hace infinita en el sentido positivo de las y, para el ángulo recto la recta vertical r que pasa por O y la vertical que pasa por E no se cortan, por lo tanto la tangente no toma ningún valor real, cuando el ángulo supera los  rad y pasa al segundo cuadrante la prolongación de r corta a la vertical que pasa por E en el punto D real, en el lado negativo de las y, la tangente

rad y pasa al segundo cuadrante la prolongación de r corta a la vertical que pasa por E en el punto D real, en el lado negativo de las y, la tangente  por tanto toma valor negativo en el sentido de las y, y su valor absoluto disminuye a medida que el ángulo

por tanto toma valor negativo en el sentido de las y, y su valor absoluto disminuye a medida que el ángulo  aumenta progresivamente hasta los

aumenta progresivamente hasta los  rad.

rad.

Resumiendo: en el segundo cuadrante el seno de  ,

,  , disminuye progresivamente su valor desde 1, que toma para

, disminuye progresivamente su valor desde 1, que toma para  rad, hasta que valga 0, para

rad, hasta que valga 0, para  rad, el coseno,

rad, el coseno, , toma valor negativo y su valor varia desde 0 para

, toma valor negativo y su valor varia desde 0 para  rad, hasta –1, para

rad, hasta –1, para  rad.

rad.

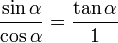

La tangente conserva la relación:

incluyendo el signo de estos valores.

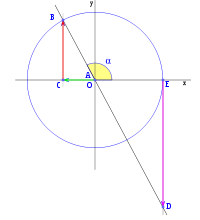

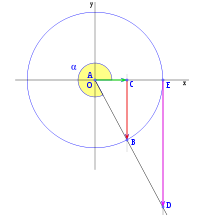

Tercer cuadrante

En el tercer cuadrante, comprendido entre los valores del ángulo  rad a

rad a  rad, se produce un cambio de los valores del seno el coseno y la tangente, desde los que toman para

rad, se produce un cambio de los valores del seno el coseno y la tangente, desde los que toman para  rad:

rad:

Cuando el ángulo  aumenta progresivamente, el seno aumenta en valor absoluto en el sentido negativo de las y, el coseno disminuye en valor absoluto en el lado negativo de las x, y la tangente aumenta del mismo modo que lo hacia en el primer cuadrante.

aumenta progresivamente, el seno aumenta en valor absoluto en el sentido negativo de las y, el coseno disminuye en valor absoluto en el lado negativo de las x, y la tangente aumenta del mismo modo que lo hacia en el primer cuadrante.

A medida que el ángulo crece el punto C se acerca a O, y el segmento  , el coseno, se hace más pequeño en el lado negativo de las x.

, el coseno, se hace más pequeño en el lado negativo de las x.

El punto B, intersección de la circunferencia y la vertical que pasa por C, se aleja del eje de las x, en el sentido negativo de las y, el seno,  .

.

Y el punto D, intersección de la prolongación de la recta r y la vertical que pasa por E, se aleja del eje las x en el sentido positivo de las y, con lo que la tangente,  , aumenta igual que en el primer cuadrante

, aumenta igual que en el primer cuadrante

Cuando el ángulo  alcance

alcance  rad, el punto C coincide con O y el coseno valdrá cero, el segmento

rad, el punto C coincide con O y el coseno valdrá cero, el segmento  será igual al radio de la circunferencia, en el lado negativo de las y, y el seno valdrá –1, la recta r del ángulo y la vertical que pasa por E serán paralelas y la tangente tomara valor infinito por el lado positivo de las y.

será igual al radio de la circunferencia, en el lado negativo de las y, y el seno valdrá –1, la recta r del ángulo y la vertical que pasa por E serán paralelas y la tangente tomara valor infinito por el lado positivo de las y.

El seno el coseno y la tangente siguen conservando la misma relación, tanto en valores como en signo, nótese que cuando el coseno vale cero, la tangente se hace infinito.

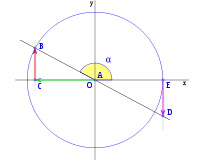

Cuarto cuadrante

En el cuarto cuadrante, que comprende los valores del ángulo  entre

entre  rad y

rad y  rad, las variables trigonométricas varían desde los valores que toman para

rad, las variables trigonométricas varían desde los valores que toman para  rad:

rad:

hasta los que toman para  rad pasando al primer cuadrante, completando una rotación:

rad pasando al primer cuadrante, completando una rotación:

como puede verse a medida que el ángulo  aumenta, aumenta el coseno

aumenta, aumenta el coseno  en el lado positivo de las x, el seno

en el lado positivo de las x, el seno  disminuye en el lado negativo de las y, y la tangente

disminuye en el lado negativo de las y, y la tangente  también disminuye en el lado negativo de las y.

también disminuye en el lado negativo de las y.

Cuando  , vale

, vale  ó

ó  al completar una rotación completa los puntos B, C y D, coinciden en E, haciendo que el seno y la tangente valga cero, y el coseno uno, del mismo modo que al comenzarse el primer cuadrante.

al completar una rotación completa los puntos B, C y D, coinciden en E, haciendo que el seno y la tangente valga cero, y el coseno uno, del mismo modo que al comenzarse el primer cuadrante.

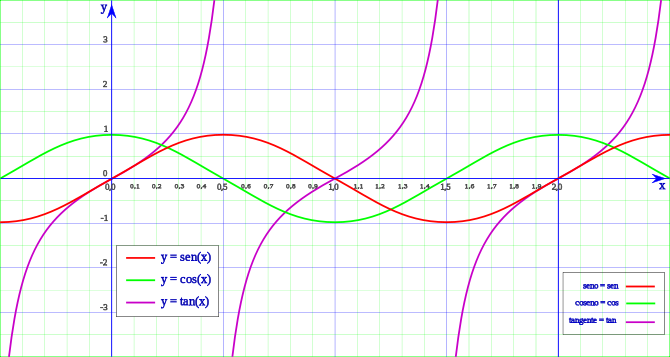

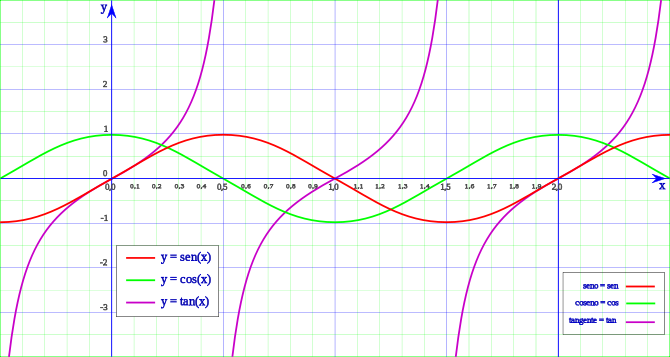

Representación gráfica

Representación de las funciones trigonométricas en el plano xy, los valores en el eje x multiplicados por

π radianes.

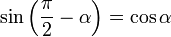

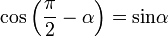

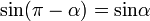

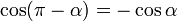

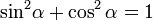

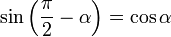

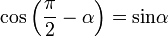

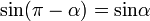

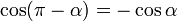

Identidades trigonométricas

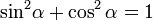

Una identidad es una igualdad en que se cumple para todos los valores permisibles de la variable. En trigonometría existen seis identidades fundamentales:

Recíprocas

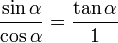

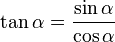

De división

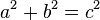

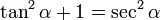

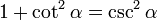

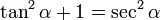

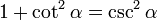

Por el teorema de Pitágoras

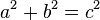

Como en el triángulo rectángulo cumple la funcion que:

de la figura anterior se tiene que:

entonces para todo ángulo α, se cumple la identidad Pitagórica :

que también puede expresarse:

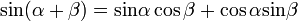

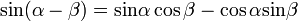

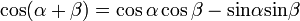

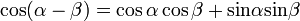

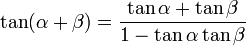

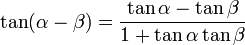

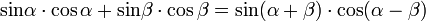

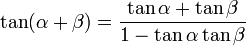

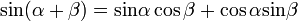

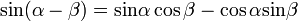

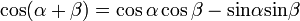

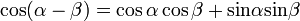

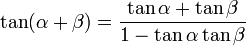

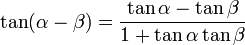

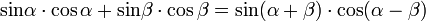

Suma y diferencia de dos ángulos

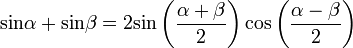

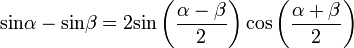

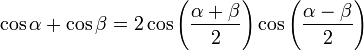

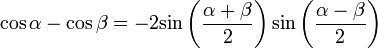

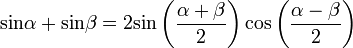

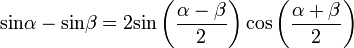

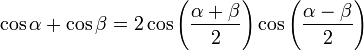

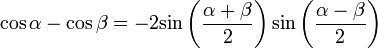

Suma y diferencia del seno y coseno de dos ángulos

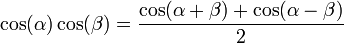

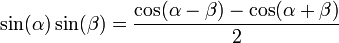

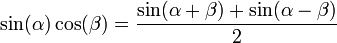

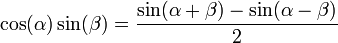

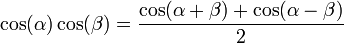

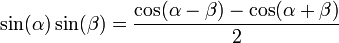

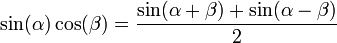

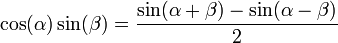

Producto del seno y coseno de dos ángulos

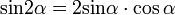

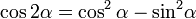

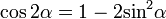

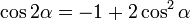

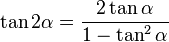

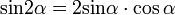

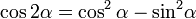

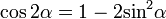

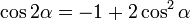

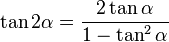

Ángulo doble

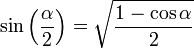

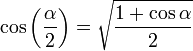

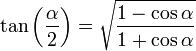

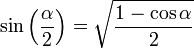

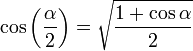

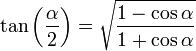

Ángulo mitad

Otras identidades trigonométricas

Véase también: Sinusoide

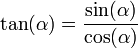

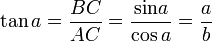

Función tangente

En un triángulo rectángulo, la tangente (abreviada como tan o tg) es la razón entre el cateto opuesto y el cateto adyacente.

El valor de la tangente para algunos ángulos importantes es:

tan = AC / OA = BD / OB = sen / cos tan (π/2) = tan (90°) = +∞ tan (-π/2) = tan (-90°) = -∞ tan (0) = 0 tan (π/4) = tan (45°) = 1 tan (π/3) = tan 60°=  tan (π/6) = tan 30° =

tan (π/6) = tan 30° =

Una identidad de importancia con la tangente es:

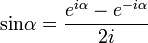

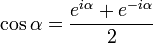

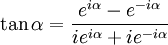

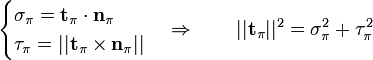

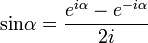

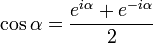

Seno y coseno, funciones complejas

El seno y coseno se definen en matemática compleja, gracias a la fórmula de Euler como:

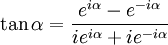

Por lo tanto, la tangente quedará definida como:

Siendo  (también puede representarse como j).

(también puede representarse como j).

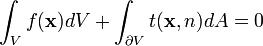

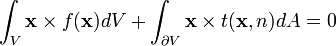

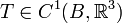

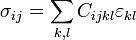

un medio continuo deformado, entonces en cada subdominio

un medio continuo deformado, entonces en cada subdominio  existe un campo vectorial

existe un campo vectorial  , llamado campo de tensiones, tal que las fuerzas de volumen

, llamado campo de tensiones, tal que las fuerzas de volumen  y el campo de tensiones

y el campo de tensiones  satisfacen las siguientes ecuaciones de equilibrio:

satisfacen las siguientes ecuaciones de equilibrio:

con las siguientes propiedades:

con las siguientes propiedades:

,](https://4actdani.blogia.com/upload/externo-3f8aeabf0400a3f39d0c6ba26d0bad9c.png)

, siendo

, siendo

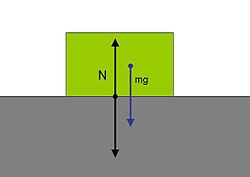

Cuando un cuerpo está apoyado sobre una superficie ejerce una fuerza sobre ella cuya dirección es perpendicular a la de la superficie. De acuerdo con la Tercera ley de Newton, la superficie debe ejercer sobre el cuerpo una fuerza de la misma magnitud y dirección, pero de sentido contrario. Esta fuerza es la que denominamos Normal y la representamos con N.

Cuando un cuerpo está apoyado sobre una superficie ejerce una fuerza sobre ella cuya dirección es perpendicular a la de la superficie. De acuerdo con la Tercera ley de Newton, la superficie debe ejercer sobre el cuerpo una fuerza de la misma magnitud y dirección, pero de sentido contrario. Esta fuerza es la que denominamos Normal y la representamos con N.

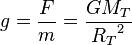

es el vector unitario que va del centro de gravedad del objeto 1 al del objeto 2.

es el vector unitario que va del centro de gravedad del objeto 1 al del objeto 2.

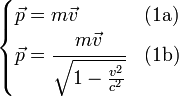

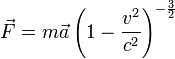

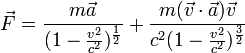

la velocidad de ésta medida desde un cierto sistema inercial. Esta segunda formulación de hecho incluye implícitamente definición (

la velocidad de ésta medida desde un cierto sistema inercial. Esta segunda formulación de hecho incluye implícitamente definición (

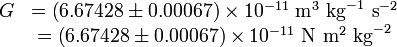

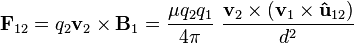

, la fuerza de la partícula 1 sobre la partícula 2 es:

, la fuerza de la partícula 1 sobre la partícula 2 es:

es el vector director unitario que va de la partícula 1 a la 2. Análogamente, la fuerza de la partícula 2 sobre la partícula 1 es:

es el vector director unitario que va de la partícula 1 a la 2. Análogamente, la fuerza de la partícula 2 sobre la partícula 1 es:

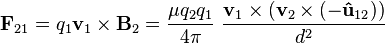

, puede verse que la primera fuerza está en el plano formado por

, puede verse que la primera fuerza está en el plano formado por  que la segunda fuerza está en el plano formado por

que la segunda fuerza está en el plano formado por  . Por tanto, estas fuerzas no siempre resultan estar sobre la misma línea, aunque son de igual magnitud.

. Por tanto, estas fuerzas no siempre resultan estar sobre la misma línea, aunque son de igual magnitud.

, correspondiente al vértice A, situado en el centro de la circunferencia.

, correspondiente al vértice A, situado en el centro de la circunferencia.

y

y  son el radio de la circunferencia, en este caso al ser una circunferencia de radio = 1, y dadas las definiciones de las funciones trigonométricas:

son el radio de la circunferencia, en este caso al ser una circunferencia de radio = 1, y dadas las definiciones de las funciones trigonométricas:

, tenemos que A, C, y D coinciden en B, por tanto:

, tenemos que A, C, y D coinciden en B, por tanto:

y

y  aumentaran progresivamente, mientras que

aumentaran progresivamente, mientras que  disminuirá.

disminuirá. rad, la recta r será la vertical que pasa por O. Dos rectas verticales no se cortan, o lo que es lo mismo la distancia

rad, la recta r será la vertical que pasa por O. Dos rectas verticales no se cortan, o lo que es lo mismo la distancia  rad, el seno vale 1 y el coseno 0.

rad, el seno vale 1 y el coseno 0.

rad se hace infinita en el sentido positivo de las y, para el ángulo recto la recta vertical r que pasa por O y la vertical que pasa por E no se cortan, por lo tanto la tangente no toma ningún valor real, cuando el ángulo supera los

rad se hace infinita en el sentido positivo de las y, para el ángulo recto la recta vertical r que pasa por O y la vertical que pasa por E no se cortan, por lo tanto la tangente no toma ningún valor real, cuando el ángulo supera los  rad.

rad. rad, el coseno,

rad, el coseno,

rad, se produce un cambio de los valores del seno el coseno y la tangente, desde los que toman para

rad, se produce un cambio de los valores del seno el coseno y la tangente, desde los que toman para

rad, el punto C coincide con O y el coseno valdrá cero, el segmento

rad, el punto C coincide con O y el coseno valdrá cero, el segmento

rad, las variables trigonométricas varían desde los valores que toman para

rad, las variables trigonométricas varían desde los valores que toman para

al completar una rotación completa los puntos B, C y D, coinciden en E, haciendo que el seno y la tangente valga cero, y el coseno uno, del mismo modo que al comenzarse el primer cuadrante.

al completar una rotación completa los puntos B, C y D, coinciden en E, haciendo que el seno y la tangente valga cero, y el coseno uno, del mismo modo que al comenzarse el primer cuadrante.

tan (π/6) = tan 30° =

tan (π/6) = tan 30° =

(también puede representarse como j).

(también puede representarse como j).

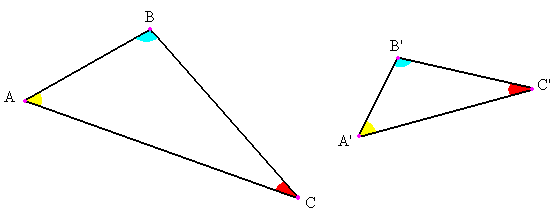

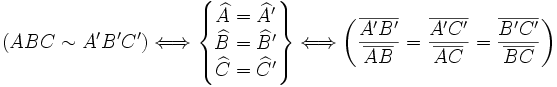

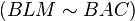

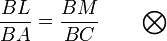

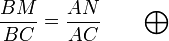

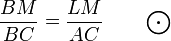

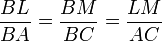

por carácter reflejo

por carácter reflejo  por ser correspondientes entre r || BC, secante AB

por ser correspondientes entre r || BC, secante AB  por ser correspondientes entre r || BC, secante AC

por ser correspondientes entre r || BC, secante AC

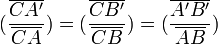

se obtiene:

se obtiene: De

De  y

y  se obtiene la consideración que llamaremos (2):

se obtiene la consideración que llamaremos (2):

por definición de semejanza.

por definición de semejanza.  por carácter simétrico.

por carácter simétrico.  por el caso I, semejanza que llamaremos

por el caso I, semejanza que llamaremos  .

. por el primer corolario de la definición.

por el primer corolario de la definición. BLM ~ BAC

BLM ~ BAC

,por lo que quedan

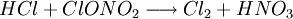

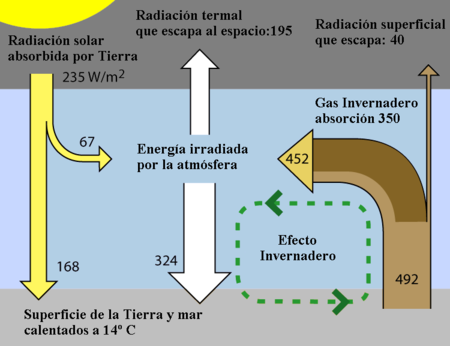

,por lo que quedan  que es la energía que no es reflejada por la atmósfera, el suelo sólido o el océano. El albedo de la Tierra es un factor causal importante de su clima, afectado por causas naturales y también por otras antropogénicas.

que es la energía que no es reflejada por la atmósfera, el suelo sólido o el océano. El albedo de la Tierra es un factor causal importante de su clima, afectado por causas naturales y también por otras antropogénicas.

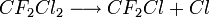

(freón 12)

(freón 12)